(Nguồn: TechCrunch)

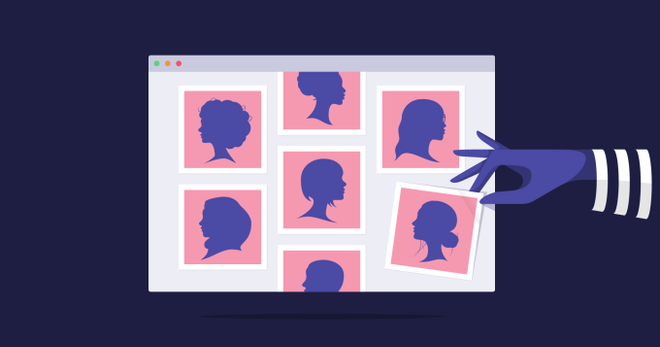

(Nguồn: TechCrunch)Ngày 15/3, Facebook cho biết họ sẽ ra mắt một công cụ trí tuệ nhân tạo (AI) mới để phát hiện sự trả thù khiêu dâm trước khi nó được người dùng báo cáo. Điều này giúp các nạn nhân của các bài viết có nội dung trả thù khiêu dâm sớm thoát khỏi chúng.

Đây là nỗ lực mới nhất của Facebook nhằm loại bỏ khỏi nền tảng của mình những nội dung lạm dụng.

"Bằng cách sử dụng máy học và trí tuệ nhân tạo, giờ đây chúng tôi có thể chủ động phát hiện những hình ảnh hoặc video khỏa thân được chia sẻ mà không được phép trên Facebook và Instagram," Trưởng bộ phận An toàn toàn cầu Antigone Davis của Facebook cho biết, trong một bài đăng trên blog.

[Facebook mở rộng thí điểm chặn ảnh nội dung trả thù khiêu dâm]

Công cụ này được đào tạo để nhận ra một bức ảnh "gần như khỏa thân" như một bức ảnh người mặc nội y, kết hợp với đoạn văn bản xúc phạm ai đó tải lên để gây bối rối hoặc tìm cách trả thù người khác. Bài viết được gắn cờ sau đó được gửi đến người bị trả thù để xác nhận.

Trong hầu hết các trường hợp bài đăng gắn cờ bị phát hiện vi phạm các tiêu chuẩn cộng đồng, Facebook cho biết, sẽ vô hiệu hóa tài khoản được liên kết.

Facebook cũng cho biết họ đang mở rộng một chương trình thí điểm được công bố trước đây cho phép người dùng mạng xã hội này tải lên và đánh dấu các hình ảnh mà họ sợ có thể được đăng lên để trả thù khiêu dâm. Ông Davis cho biết Facebook đã nhận được phản hồi tích cực từ chương trình.

Bên cạnh đó, Facebook sẽ mở một trung tâm hỗ trợ cho các nạn nhân của sự trả thù khiêu dâm, được gọi là "Không có sự đồng ý của tôi," với sự tham gia tư vấn của các chuyên gia và đại diện các tổ chức xã hội liên quan./.